教你如何在家庭NAS上通过Docker部署开源AI框架LocalAI,无需独立显卡,仅用CPU即可在本地运行大语言模型进行对话、生成图片。全程离线操作,保障数据隐私,并兼容OpenAI API,适合新手入门。附部署代码、模型安装指南及实测体验。

LocalAI:

一款开源、免费、本地优先的 AI 推理框架,核心是提供与 OpenAI(同时兼容 Elevenlabs、Anthropic 等)API 规范兼容的本地推理 REST API,支持在消费级硬件上本地 / 私有部署大语言模型(LLM)、生成图片、音频等能力,无需依赖 GPU 也可运行,覆盖多类模型家族。

核心特性:

- API 兼容:作为 OpenAI API 的即插即用替代品,现有基于 OpenAI API 开发的软件可低成本迁移;

- 本地部署:支持在消费级硬件(无 GPU 也可)上运行,数据无需外发,满足隐私 / 合规需求;

- 多能力支持:不仅支持大语言模型推理,还涵盖图片生成、音频(TTS 等)生成等能力;

- 模型生态丰富:内置 Model Gallery(模型画廊),支持通过 CLI/API 便捷安装 HuggingFace 等来源的模型,默认提供自由授权的模型库,也支持自定义画廊仓库;

- 多后端兼容:底层兼容多种后端(C++、Go、Python 等实现),适配不同模型的运行需求;

- 扩展能力:关联 LocalAGI(AI 代理编排)、LocalRecall(知识库)、Cogito(LLM 工作流库)等工具,形成完整的本地 AI 基础设施套件。

安装

Docker Compose(纯 CPU 版本)

services:

localai:

image: localai/localai:latest

container_name: localai

ports:

- 8080:8080

volumes:

- ./models:/models

restart: always使用

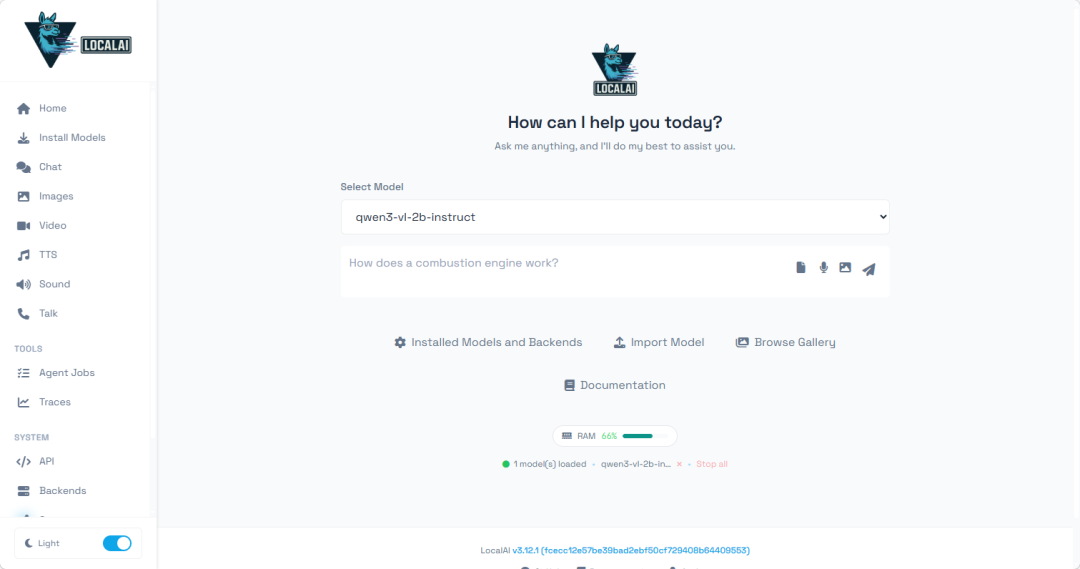

浏览器中输入 http://NAS的IP:8080 就能看到界面

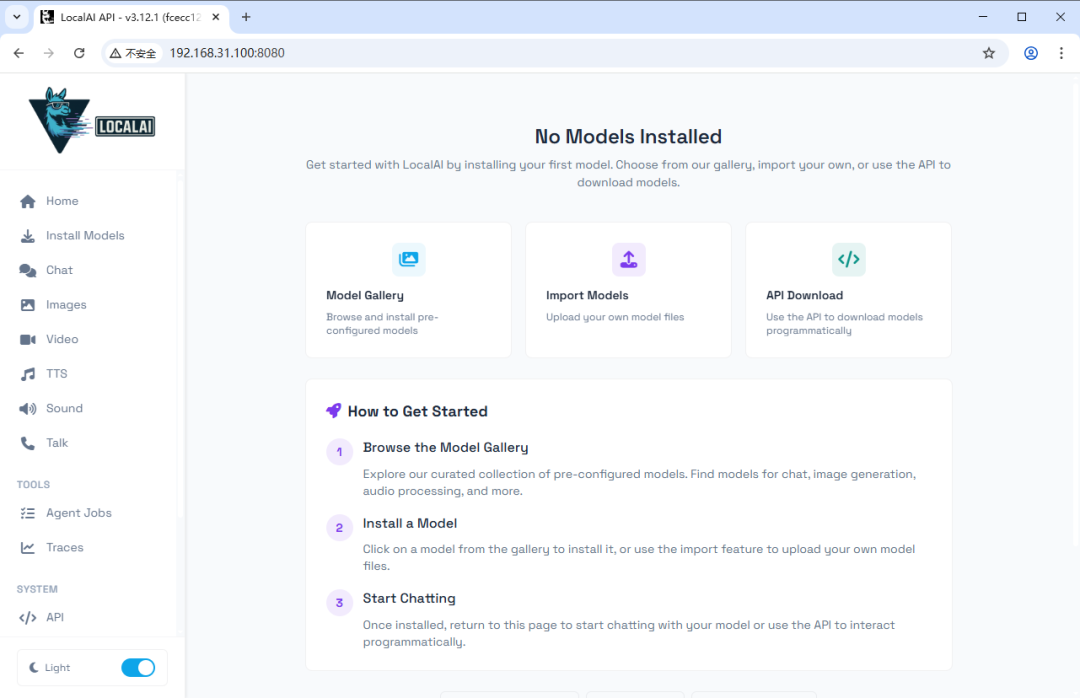

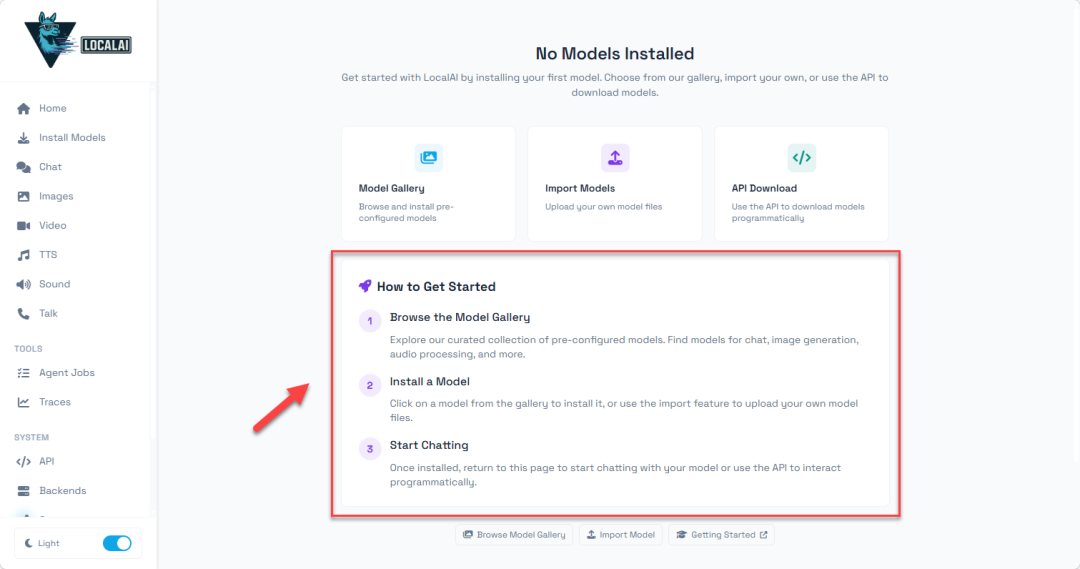

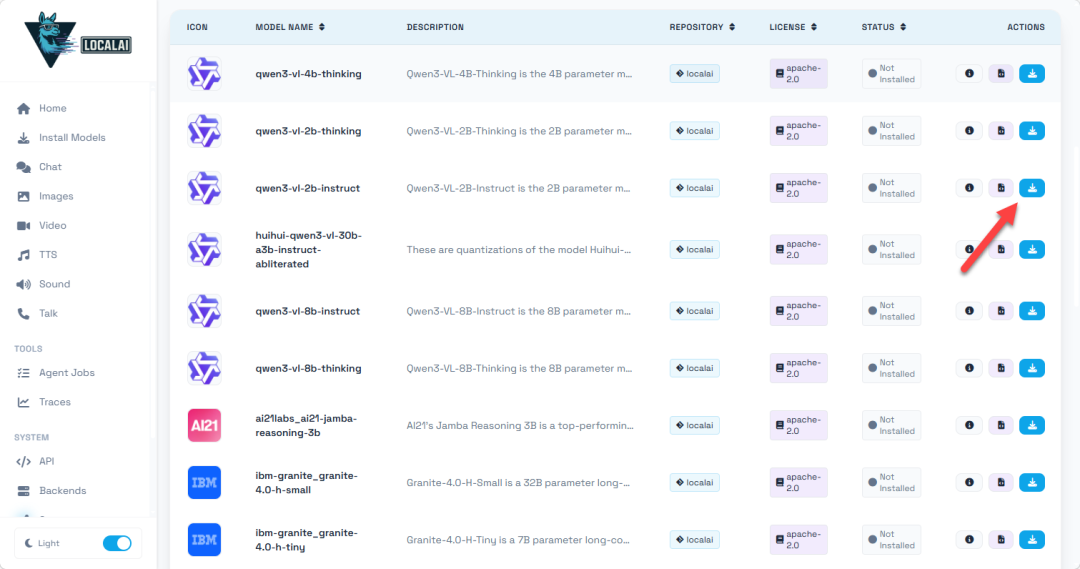

引导页面有介绍怎么样上手使用,首先浏览模型,选中需要的下载安装,最后调用进行会话

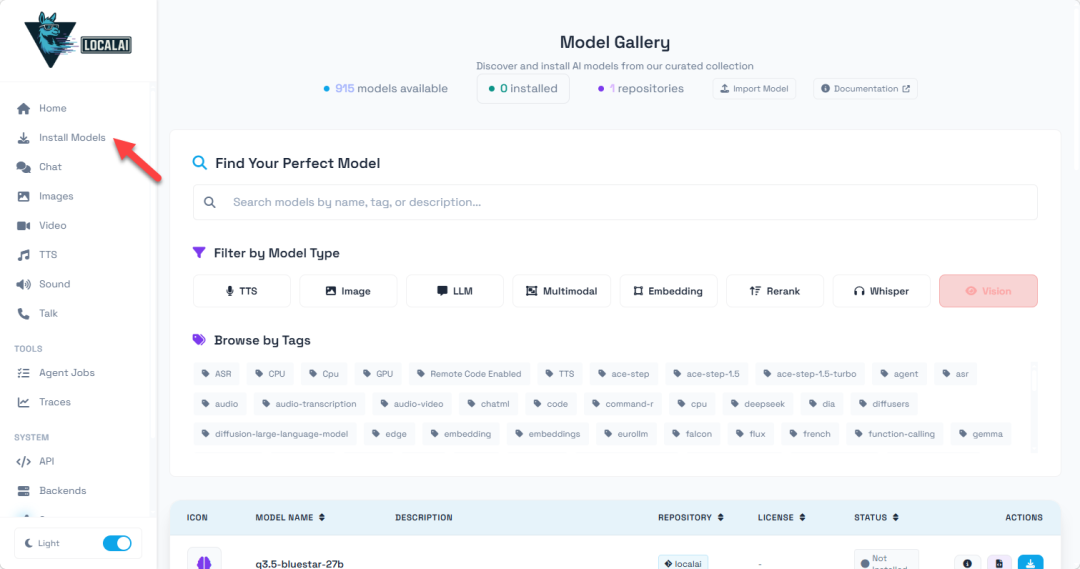

提供了挺多的模型的,都是可以直接下载(有时需要良好网络,也遇到过加载不出模型的情况,过了一天又行了)

TIP:支持离线模型上传,放到模型目录即可

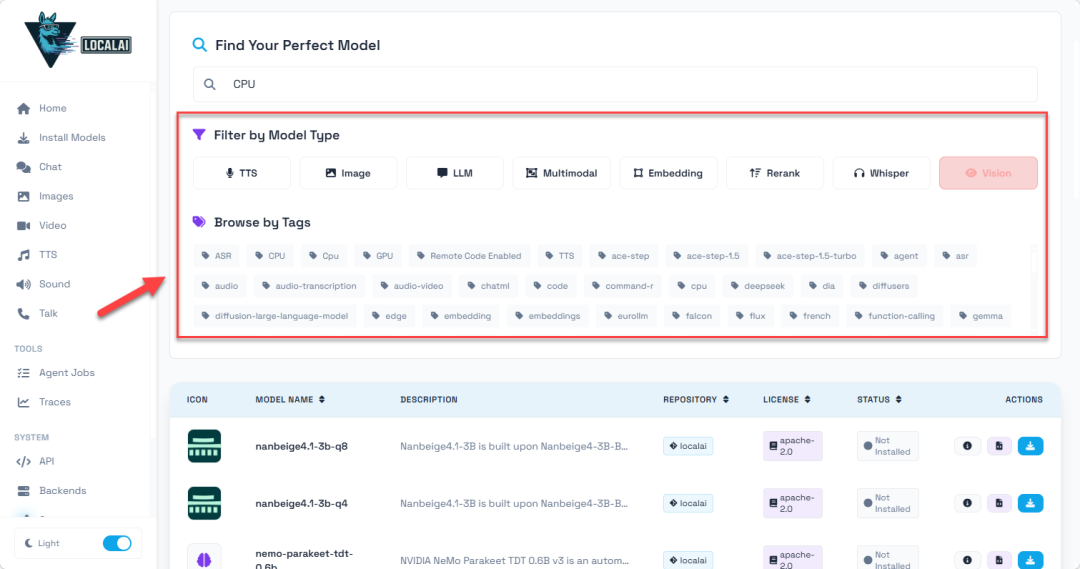

根据需求筛选模型,注意下载的模型类型

点击下载安装(因为是用于 CPU 跑,就挑选模型比较小的)

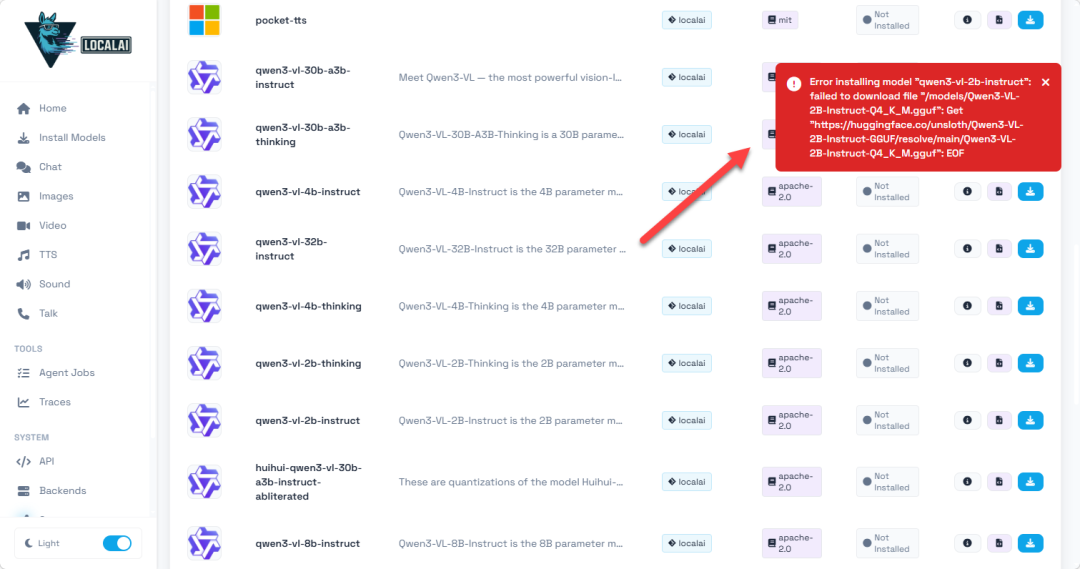

TIP:下载模型有可能提示网络问题,要良好网络

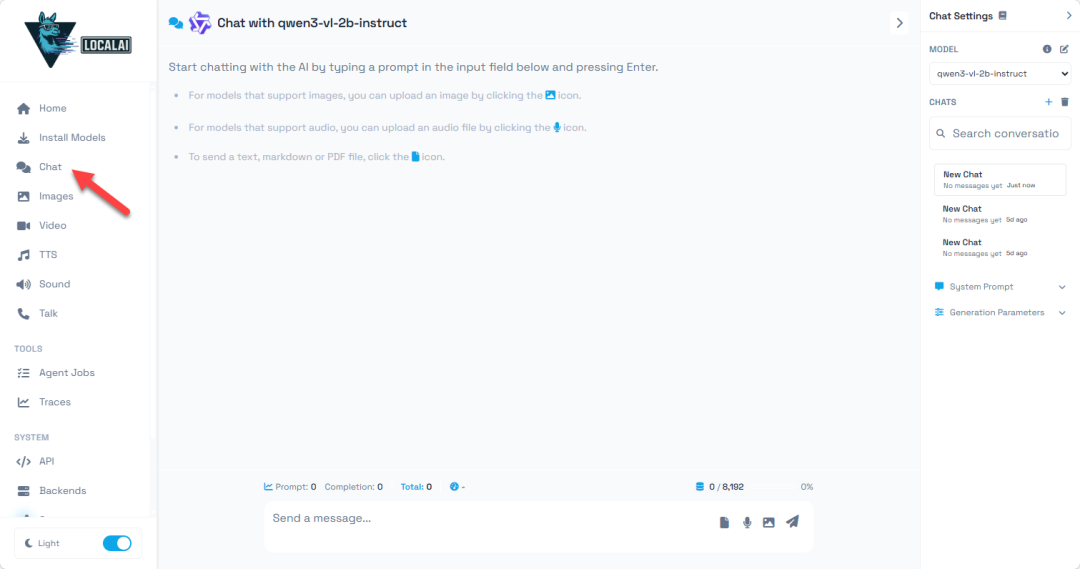

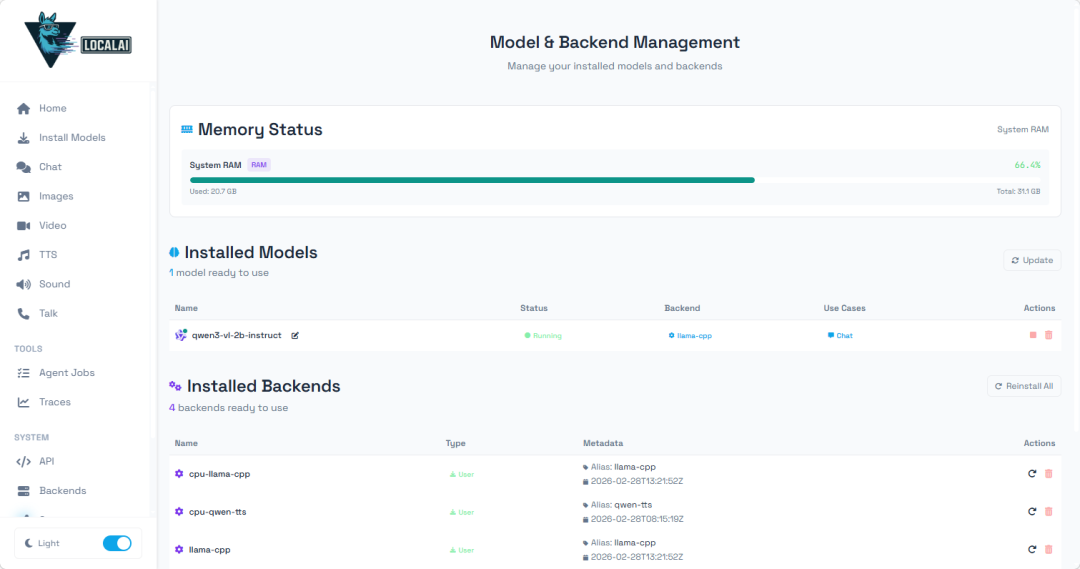

安装完成,来到对话页面

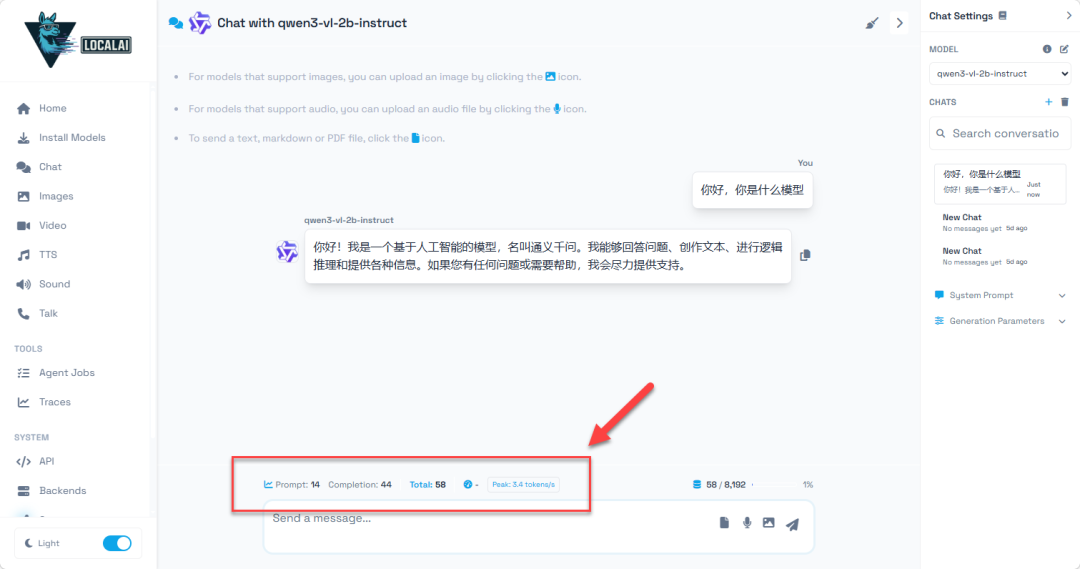

输入文字就能对话了,生成速度不是很快只有 3.4 tokens/s,但是体验也还不错

毕竟模型比较小,回答质量肯定是不如大模型的,但不需要联网可以本地运行

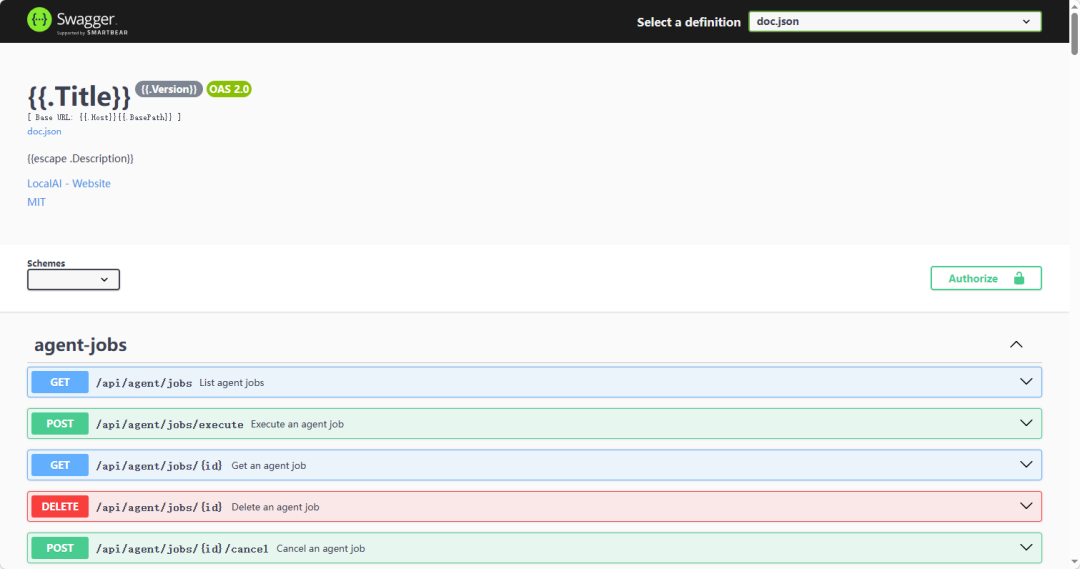

调用协议方面,支持 OpenAI(同时兼容 Elevenlabs、Anthropic 等)API 规范

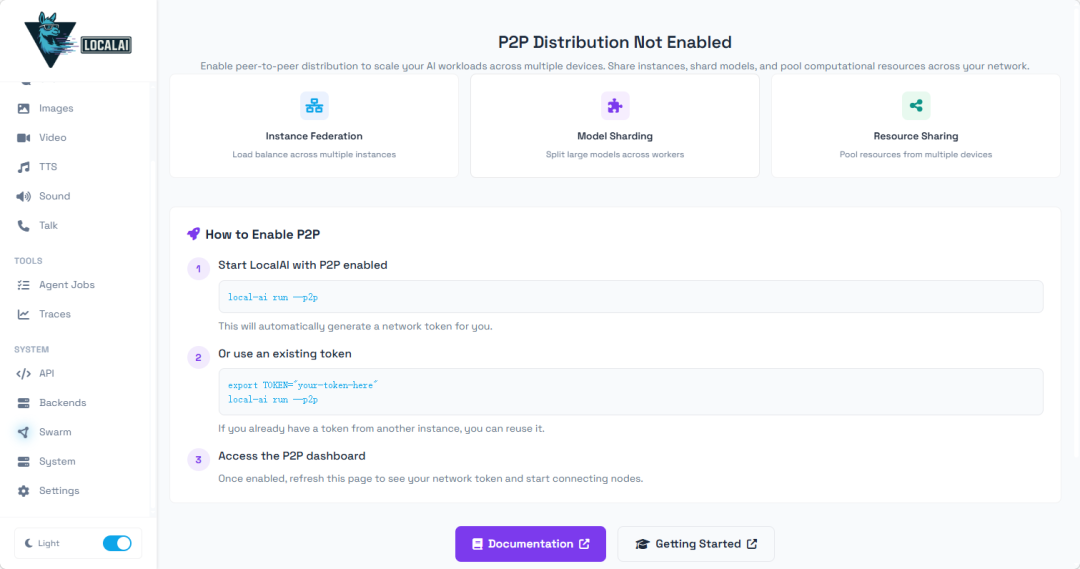

如果有集群的需求,可以部署多台设备混合推理加速

还有很多功能,我就不详细介绍了有兴趣的可以自行探索

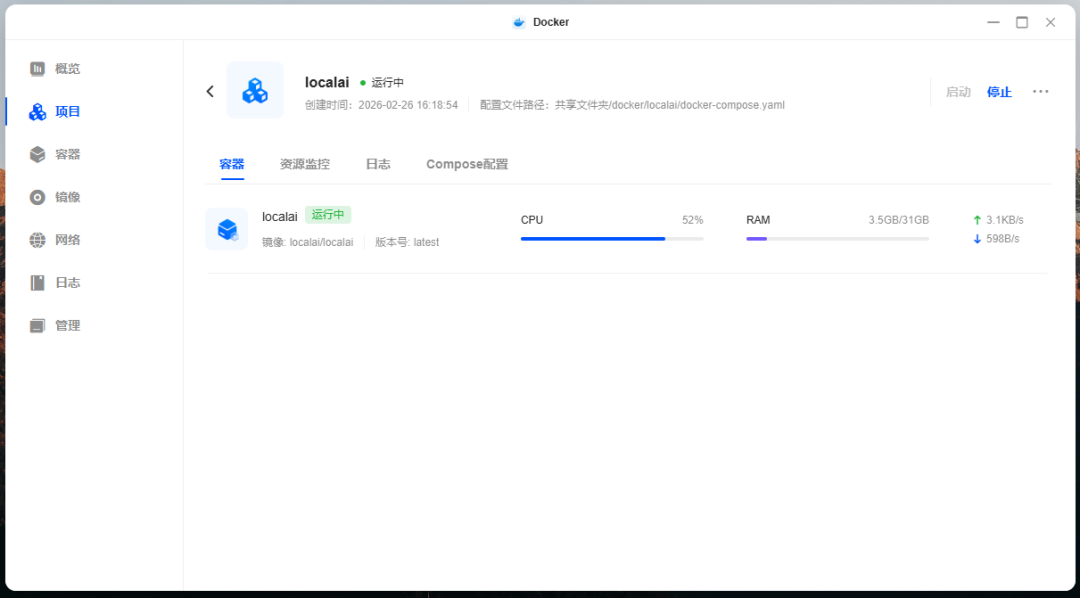

资源占用情况,2b 的模型大概占用 3.5G 内存,生成时 CPU 基本可以跑满

总结

LocalAI 整体体验十分友好,可视化界面大幅降低了新手入门门槛。它支持完全本地化部署,断网环境下也能生成速度与质量俱佳的内容;仅靠纯 CPU 即可推理运行,无需依赖 GPU;同时兼容 OpenAI API 规范,现有应用可无缝迁移;模型支持 GGUF 格式,能快速下载各大厂商最新模型。对于需要轻量化本地 AI 推理、想快速体验大模型但缺乏高端硬件的用户,LocalAI 是一款非常值得尝试的工具。

综合推荐:⭐⭐⭐⭐(可视化操作友好,接口兼容 OpenAI API 规范)

使用体验:⭐⭐⭐(界面操作易上手,扩展兼容不错)

部署难易:⭐⭐(简单)︎

觉得内容不错?我要